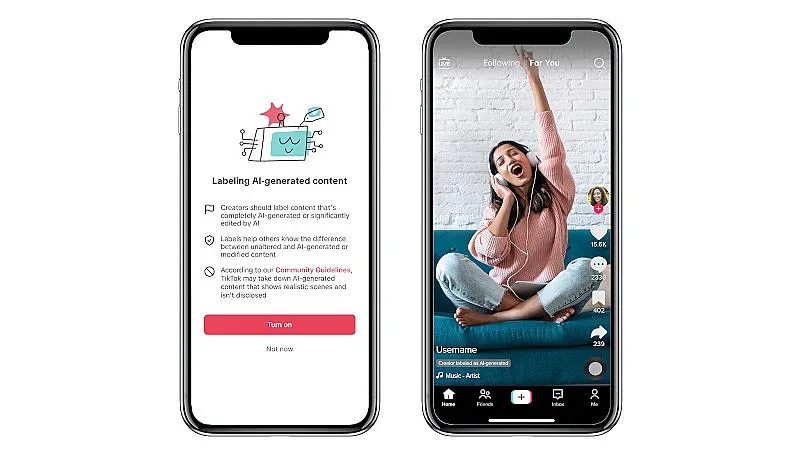

Платформата за създаване на кратки видеоклипове TikTok обяви стартирането на нова функционалност, която ще позволи на създателите изрично да посочват, че съдържанието им е създадено с помощта на изкуствен интелект. Това нововъведение беше забелязано за първи път от потребителите още миналия месец. Инициативата има за цел да повиши прозрачността и честността при създаването на съдържание.

Съгласно новите правила създателите на съдържание са длъжни да оповестяват дали материалът е създаден с помощта на ИИ. При създаването на видеоклип или снимка ще има напомняне да се активира функцията за етикетиране. Етикетът "AI" ще бъде поставен под името на потребителя в долния ляв ъгъл на видеоклипа. Компанията подчерта, че немаркираното с AI съдържание може да бъде изтрито.

TikTok планира скоро да започне да тества автоматично етикетиране на цялото съдържание с изкуствен интелект. Това ще бъде част от стремежа на компанията да осигури прозрачност и да предотврати разпространението на фалшиво съдържание, което вече е натрупало милиони гледания чрез използването на софтуер за клониране на гласове, фалшиви песни и видеоклипове на известни личности.

Освен това TikTok задължава създателите на филтри и ефекти да преименуват инструментите, задвижвани от изкуствен интелект, като добавят към имената им съкращението "AI". Например филтърът за лице Bold Glamour, който се появи в TikTok през март, ще бъде подложен на процес на преименуване.

Целта на TikTok е да създаде среда, в която потребителите да могат уверено да различават истинското съдържание от създаденото от AI. Това ще помогне да се предотврати разпространението на дезинформация и да се поддържа доверието на аудиторията в платформата.

Последвайте ни в Google News Showcase за важните новини

Вижте всички актуални новини от Standartnews.com